Stable Diffusion for WebUI二次元AI绘画脚本

和Disco Diffusion相比,Stable Diffusion for WebUI是一个更加容易上手的AI绘画脚本,SD与DD相比,只要将https://github.com/AUTOMATIC1111/stable-diffusion-webui 中的脚本克隆到本地,先后在命令行中运行webui-user.bat和webui.bat,即可完成python虚拟环境构建、所需模块下载安装等工作,当然,前提是本地已经安装了python3.6以上版本以及CUDA等模块。只要在stable-diffusion-webui/models/Stable-diffusion/子目录中拷贝进下载的模型,SD就可以运行了。

SD的使用比SD更直观和简单。每次开始时先运行webui-user.bat,提示加载完成可以访问浏览器后,就可以在本地电脑的浏览器中访问http://127.0.0.1:7860进行AI绘画了,整个设置和输出界面都在网页上进行呈现,比DD在本地运行时直接操作笔记本脚本要友好许多。SD同DD一样,用文字告诉它你想生成一张什么样的照片,只不过不需要完整的一句话,只需要一个一个的关键词用逗号分隔即可,这些词叫Tag.整个运行也比DD要快许多,512*512的图片大约十余秒就可以生成一张。

SD出来的效果和所采用的模型有很大关系。在github上发布方给出的是sd-v1-4-full-ema.ckpt 以及 sd-v1-4.ckpt两个模型,分别是4.2G和7.6G大小,用这个模型生成的是照片和绘画风格的图像,老实说不好看,而且诡异的地方很多,比如生成的人有三条腿什么的。SD的优势是二次元绘画,下载了网上泄露的二次元模型后,做出来的动画还挺有意思。加载不同的模型生成的结果截然不同,因此更换不同的模型试验可以让你玩很长的时间。但是model子目录中一次只认一个模型,因此可以把下载的所有模型拷贝进去,将想要运行的模型名称改为排序最靠前的即可识别加载。

SD资源参考:

模型下载: https://rentry.org/sdmodels

SD综合信息:https://rentry.org/sdupdates

Tag生成网站:https://wolfchen.top/tag/

https://aitag.top/

Tag魔法书:https://docs.qq.com/doc/DWHl3am5Zb05QbGVs?

https://docs.qq.com/doc/DYVJUZU5VdXdDeWNI?

https://docs.qq.com/doc/DSHBGRmRUUURjVmNM

https://docs.qq.com/sheet/DRGR5RHVQeVhqUENG?tab=BB08J2

https://www.kdocs.cn/l/cvg8ccOGj5sq

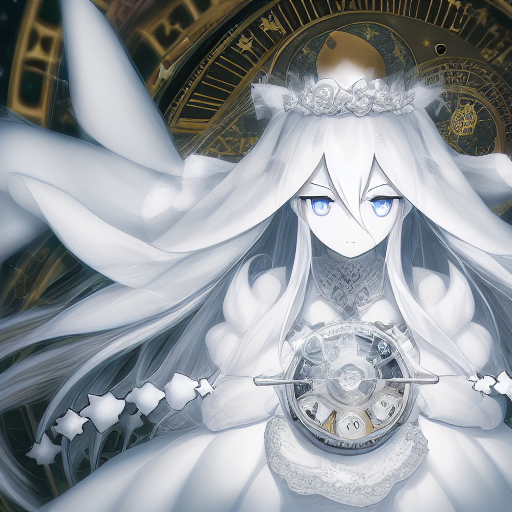

下面是试验的输出画作:

Tag:a little bear,brown,qute,scarf,white snow,christmas

Tag:a bride,black and white hair,star eyes,Close-up,Immortality of Eternity, poetry, Astronomical clock,white wedding dress,forever time,